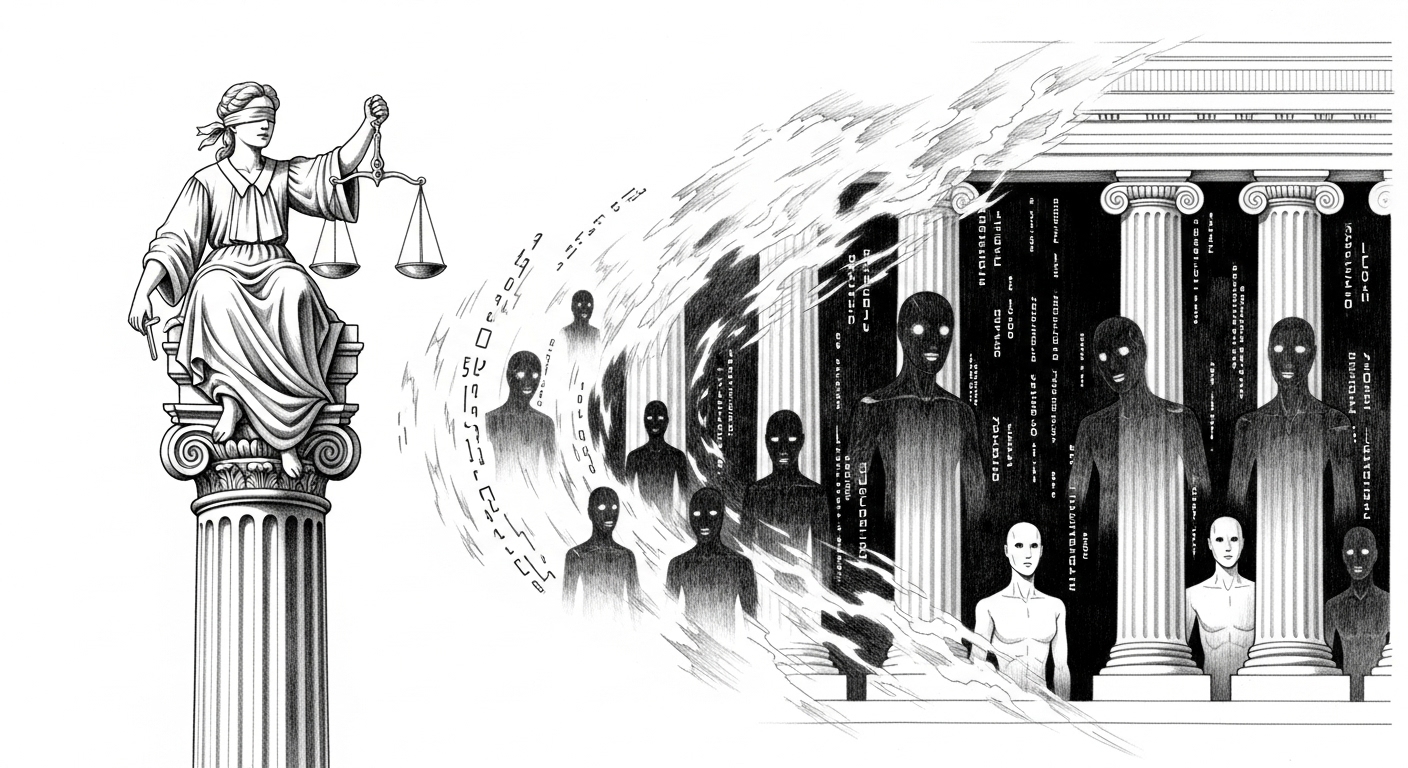

أدى الانتشار المتزايد لاستخدام الذكاء الاصطناعي في البحث القانوني إلى بروز ظاهرة مثيرة للقلق، حيث قُدّمت حجج قانونية أمام قضاة في دول مثل المملكة المتحدة، الولايات المتحدة، كندا وأستراليا استنادًا إلى أحكام محاكم مزيفة تم إنشاؤها بواسطة أدوات الذكاء الاصطناعي. وعلى الرغم من قدرة الذكاء الاصطناعي على تسريع البحث وتسهيله، إلا أن هذه الأدوات تنتج أحيانًا ردودًا تبدو مقنعة، لكنها في الحقيقة غير دقيقة أو مختلقة بالكامل، مما يهدد نزاهة الإجراءات القانونية.

مؤخرًا، سلّط بول لام تينغ كوك، أمين العدل في هونغ كونغ، الضوء على هذا التهديد خلال حفل استقبال للمحامين الجدد، مؤكدًا على التحذيرات التي أثيرت في قضية شهدتها محكمة بريطانية مؤخرًا، حيث شدد القضاة على أن أدوات الذكاء الاصطناعي الحالية "غير قادرة على إجراء بحث قانوني موثوق". ومع تسارع وتيرة تبنّي التقنيات الحديثة في القطاع القانوني، يؤكد خبراء ومختصون ضرورة وضع ضمانات وآليات تحقق فعالة، للحيلولة دون انتشار المعلومات المضللة وتقويض ثقة المجتمع في منظومة العدالة.

النقاط الرئيسية

- أسفرت أبحاث قانونية أنتجتها أدوات الذكاء الاصطناعي عن قيام محامين بتقديم أحكام قضائية غير صحيحة أو مختلقة أمام محاكم في عدة دول.

- يمكن للأدوات الحالية للذكاء الاصطناعي إنتاج معلومات مقنعة في ظاهرها لكنها غير دقيقة أو منتحلة.

- دعا أمين العدل في هونغ كونغ إلى ممارسة مزيد من الحذر والتمسك بالنزاهة عند استخدام الذكاء الاصطناعي في المجال القانوني.

- قضت محكمة بريطانية مؤخرًا بعدم قدرة أدوات الذكاء الاصطناعي حتى الآن على إجراء أبحاث قانونية موثوقة.

- تتزايد المخاوف من أن إساءة استخدام الذكاء الاصطناعي قد يؤدي إلى تقويض ثقة الجمهور في منظومة العدالة.

في جملة واحدة

يثير استخدام الذكاء الاصطناعي في السياقات القانونية قلقاً متزايداً، مع وصول أبحاث قانونية غير دقيقة أو ملفقة إلى أروقة المحاكم. ويدعو الخبراء والسلطات المهنية القانونية إلى ضرورة التحقق الدقيق من المعلومات التي ينتجها الذكاء الاصطناعي، لضمان نزاهة العدالة وحماية مصداقيتها.

المصادر: 1